Comment faire du Big Data ? La voie la plus simple pour réussir

Dans votre entreprise aussi, le sujet est fiévreusement sur toutes les lèvres ? Comment faire du Big Data ? Comme si la réussite et la transformation de vos activités pour survivre à la "transition fulgurante" ne dépendaient que de ça. On comprend le sentiment de vertige prenant ceux qui ne disposent même pas encore de l'information nécessaire pour piloter facilement leur budget ou anticiper l'évolution de leurs activités. Mais "puisqu'il faut y aller, il faut y aller" !

N'est-ce pas ce qu'ont fait les géants qui réussissent ? Jeff Bezos n'a-t-il pas propulsé Amazon au firmament de la distribution en surfant sur la technologie et les données ?

" Trop cher et compliqué pour nous!", disent peut-être certains esprits chagrins autour de vous. Confiance ! Vous avez tout pour réussir. Suivez le guide.

La recette est très simple : frugalité des moyens techniques pour inciter vos équipes à mettre le sens au coeur de la démarche. En matière de data, une 2ème clé : aller à l'essentiel et ignorer le superflu. Seiri, comme disent les japonais ; supprimez l'inutile !

Un repère tout simple pour vérifier que les proportions sont bonnes : pas plus de 35 EUR de dépenses de technologie pour 65 EUR de dépenses en hommes et en méthodologie ! Conseil d'Intégrateur ;)

Le Big Data, c'est quoi ?

Qu'est-ce donc que cette Big Data ? L'expression courante recouvre 2 réalités. Une formidable opportunité, via la digitalisation des points de contact et la généralisation d'usage de capteurs dans les fameux IOT (objets connectés), de connaître le détail de la vie de vos produits et des préférences de vos clients. Autrement dit, une opportunité unique de développer vos ventes, fidéliser, améliorer la qualité, vous transformer. Mais Big Data désigne aussi, et avant tout, la masse des données générées. Il est fondamental de ne pas confondre les 2. Une opportunité d'un côté, un problème d'infobésité à gérer de l'autre.

Une série de questions éthiques et techniques, et un peu de temps pour les traiter

Ce serait donc une question de systèmes d'information à régler ? Pas de problème, car vous avez sous la main un DSI compétent. Mais où est-il et que fait-il en ce moment ? Il est héroïque, car il est sur tous les fronts ! Transformation digitale des front-office, intégrations de vos systèmes avec les Tiers, dématérialisation continue des flux, en garantissant toujours la continuité de l'activité... Heureusement dans plus en plus d'endroit un renfort récent, avec l'arrivée d'un Chief Data Officer pour gérer la masse exponentielle de données.

Rien que sur ce sujet, pas plus big que les autres, une bonne liste de questions à régler : quels outils de collecte pour ces nouvelles données ? Où les stocker ? Avec quel mode de stockage distribué ? C'est tout juste si vos geeks maison s'y retrouvent avec des technologies nouvelles qui s'enchaînent. Cela serait presque tentant d'occulter une partie des questions juridiques et éthiques. Quelles données peut-on et doit-on conserver ? Doit-on se laisser tenter par d'alléchantes offres dans le Cloud, mais permettre un jour à des tiers U.S. d'y accéder, via le Patriot Act par exemple ? Car après tout il est possible de se dire, "qui sommes-nous et qui pouvons-nous intéresser ?" Faut-il vraiment monter et gérer un environnement hybride ou On premise plus protecteur pour vos consommateurs et votre innovation ? Référentiel ? Qualité ? RGPD ? Protection des données ? N'en jetez plus, le sujet Data semble de loin terriblement compliqué.

Vers où tourner le regard alors ? Car tout le monde en parle ! Vos traditionnels conseils en stratégie, font maintenant de la transformation digitale. Ils ont fraichement embauché des Data Scientists pour rester dans la course. Les intégrateurs spécialistes de la BI (Business Intelligence) en contact avec votre DSI font maintenant de la stratégie !? Heureusement qu'il reste les éditeurs de logiciels cités par le Gartner... mais ne vous ont-ils pas déjà déçus avec cette dernière nouvelle technologie qui devait tout révolutionner ?

"Confiance", vous dis-je, vous avez déjà tout pour réussir !

Mais revenons à Jeff Bezos, le patron d'Amazon le champion de l'adaptation. Que dit-il lui ? En substance, "On me pose toujours la question de ce que sera devenu le business dans 20 ans, mais personne ne me demande ce qui n'aura pas changé. C'est dommage, car cette question est tout aussi intéressante, et c'est sur la réponse qu'on construit les Business de demain..." Il complète "pour Amazon c'est le délai et le prix", un résumé de l'expérience client pour le distributeur qu'il est.

Le bon sens et les hommes en renfort de la DG

Car Jeff Bezos nous parle de la vocation d'Amazon. Le fameux Why de Simon Sinek, dont vous parle votre directrice marketing à chaque fois que vous la croisez. Qu'est-ce qui ne va pas changer dans votre métier ? Quels sont les indicateurs mesurant ces invariants ? C'est une première bonne question.

Il y en a d'autres. Que souhaite-t-on apprendre ? Quelle question veut-on éclairer par ces données ? Il est ensuite possible de rassembler toutes les informations utiles pour mener à bien l'enquête. Prévoir les inconvénients possibles, et les répercussions secondaires est judicieux, vous le savez. À quoi bon, par exemple, collecter une information, dont la volumétrie va être un obstacle à l'analyse ? C'est la question que pose l'un des chefs de projet de la plus grande base de données européenne jamais réalisée.

"En fait, la question est : comment ne pas faire du Big-Data ?". Comment ne pas rendre sourde la tête de l'organisation par un bruit de données en réussissant à filtrer aux différents niveaux de l'entreprise les informations inutiles et en laissant passer celles qui sont pertinentes ?" C'est plus une question d'hommes et d'analyse des besoins réels que de systèmes. La loi de l'obésité de ces big data est la suivante : elles seront d'autant plus big que l'indétermination de l'objectif sera grande.

Pour maîtriser la data et réussir à entrer de plain-pied dans cette nouvelle ère digitale, il faut donc mettre l'essentiel au coeur de la démarche. L'entreprise dans l'axe de sa vocation. L'homme et son bon sens au coeur des changements. N'est-ce pas ce que font les Hénokiens, ces entreprises familiales pluri-centenaires, qui ont réussi à passer les modes et les années en misant sur les hommes ?

Illustrons l'importance des hommes avec 2 sujets clés pour les données. La question des référentiels en premier : pour trier des choux, de carottes, des fraises et des poires, il est intéressant de distinguer les fruits des légumes, puis éventuellement de faire appel à la notion de "Vegetable" pour pouvoir toutes les sommer.

Qui va créer une classification sensée ? L'intelligence Artificielle ? Surement pas la première fois. Cette grille de lecture est pourtant décisive pour l'analyse efficace de votre activité. Elle conditionne aussi la maîtrise de la communication aux régulateurs, à votre maison-mère, à vos filiales ou encore permet de s'étalonner avec les meilleurs du secteur. Là aussi c'est d'abord une question liée à l'intelligence du métier.

Autre exemple : la qualité des données. Toutes les personnes qui se sont penchées sur le sujet savent qu'une des clés est d'associer les collaborateurs en faisant en sorte que la collecte fasse sens pour eux.

La recette n'est pas si compliquée. Évitez l'inutile et laissez de la place aux Hommes

D'abord le sens, c'est toute la recette du Lean Data Management : frugalité des moyens techniques pour inciter l'homme à aller à l'essentiel et à ignorer le superflu, mode effectual et itératif pour obtenir vite des résultats concrets, échanges bienveillants entre DSI et hommes des métiers, en conscience des contraintes et des limites de chacun, pour aller dans une direction bien identifiée.

Concluons avec Elon Musk, le patron des "barbares" cité par Jean Staune le fameux prospectiviste français. Elon Musk s'est attaqué avec succès au marché de l'automobile (Tesla), à la Nasa (Space X), ou encore à Google et Facebook sur la question de l'Intelligence Artificielle. Qu'a-t-il fait dernièrement ? Il a créé Neuralink qui travaille sur l'interface homme/machine pour permettre à l'Homme de rester dans la course face à l'Intelligence Artificielle. L'homme et la technologie ensemble pour réussir, voilà le rêve fou du visionnaire américain. N'est-ce pas ici aussi une question de bon dosage ?

Témoignage client : Ludovic Labbé, DSI chez Leasecom

Ludovic Labbé, DSI chez Leasecom, témoigne de son expérience avec Essentiel Info

Filiale de FINTAKE, disrupteur dans le secteur bancaire, Leasecom est spécialiste du financement en location financière évolutive. Avec 1 200 partenaires revendeurs, Leasecom accompagne plus de 31 000 entreprises et organisations dans le financement et la gestion locative de leurs équipements professionnels, générant ainsi un chiffre d’affaires de 170 millions d’Euros.

Notre interlocuteur, M. Labbé, est Directeur des Systèmes d’Informations chez Leasecom.

Consultant Essentiel Info : Bonjour M. Labbé, merci d’avoir accepté de répondre à nos questions. Pouvez-vous nous donner votre vision du rôle du DSI sur la question de la donnée ?

M. Labbé : Pour moi le DSI est un facilitateur avisé. Il est le garant de la cohérence de la donnée. Mais attention, il ne faut confondre cela avec la garantie de la qualité de la donnée car une donnée cohérente peut être de mauvaise qualité. Cette question de la qualité dépasse en effet son strict périmètre car elle met en jeu les processus, la qualité des règles métiers, la saisie des utilisateurs… En revanche, si le DSI n'est pas le garant de la qualité de la donnée, il doit être partie prenante pour proposer des solutions visant à améliorer la qualité de la donnée de l'entreprise. Le DSI n'est pas non plus le fournisseur de la donnée en tant que tel mais il donne les outils pour en tirer le meilleur parti (en tirer le meilleur parti est le rôle des Datas Analysts, des spécialistes métiers et du contrôle de gestion). D’une manière générale, le DSI n'est pas là pour faire ce que demandent les utilisateurs, c'est une sorte de paradoxe mais cette notion est fondamentale ! Il est là pour comprendre le besoin sous-jacent afin d'y apporter la meilleure solution possible.

Racontez-nous, quelle était la situation chez Leasecom avant votre partenariat avec Essentiel Info ?

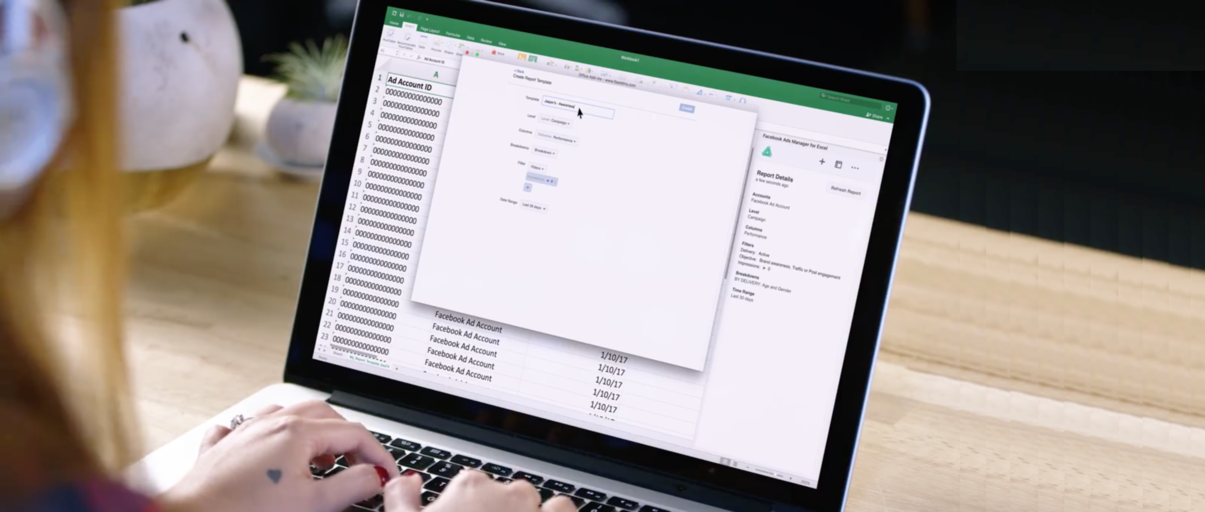

Les équipes du Contrôle de Gestion exploitaient leurs données sous forme d’extraction sur Excel. C’est un outil très utilisé par certains métiers et notamment par le contrôle de gestion. D’une manière générale, je considère quand même que la forte présence d’Excel est le signe d’un système d’information non mature. De cette façon, les équipes du Contrôle de Gestion constituaient des bases de données dans Excel, des fichiers au volume important, parfois supérieur à 40 Mégaoctets. Cette démarche a créé un système d’information en marge du système d’information de l’entreprise. Les données extraites étaient stockées sur Excel. Elles étaient ensuite retravaillées par les équipes du Contrôle de Gestion, elles n’étaient donc pas issues directement du système d’information. On peut facilement comprendre la raison au retraitement des données : les données ne sont pas propres ni cohérentes, elles méritent ainsi d’être retraitées pour être présentées à la Direction. Seulement, la raison invoquée est aussi une mauvaise raison car le nettoyage des données aurait dû se faire en amont. Ce n’est pas le métier du Contrôleur de Gestion, qui doit analyser un ensemble de données, mais bien une approche DSI. Dans ce cas de figure qu’était le nôtre, les équipes du contrôle de gestion investissaient beaucoup d’énergie au retraitement la donnée au dépend du temps de l’analyse de cette même donnée. Par ailleurs, nous avons été amenés à adapter notre posture vis-à-vis d’une donnée de mauvaise qualité. Alors qu’autrefois des corrections manuelles étaient apportées, aujourd’hui nous acceptons la donnée de mauvaise qualité (quand elle est avérée). Nous ne cherchons plus à la corriger mais juste à la mettre en évidence et à identifier la cause de cette non qualité pour adapter nos processus d’acquisition.

Quel était le besoin des équipes du Contrôle de Gestion de Leasecom ?

Le tableur Excel est le meilleur outil du Contrôleur de Gestion car il lui offre une latitude qui lui est chère. Il nous fallait un outil qui s’adapte parfaitement à Excel, un outil qui puisse s’appuyer sur l’existant tout en décuplant les capacités du tableur. En tant que DSI, il fallait bien entendu un outil qui assure la sécurité des données et l’unicité de l’information. Nous ne voulions plus que les Contrôleurs de Gestion constituent des bases de données dans Excel avec tous les risques que cela comprend en terme de vol ou de perte des fichiers, de retraitement des données et la création système d’information en marge du système d’information de l’entreprise.

M. Labbé, d’un point de vue technique, en quoi Inside a répondu à vos attentes précisément ?

Il y a plusieurs points de réponse à cette question. Tout d’abord, Inside est un progiciel de type add-in Excel, il est donc totalement intégré à Excel. Inside s’adapte ainsi à l’univers parfaitement maitrisé du Contrôleur de Gestion. Il octroie à ses utilisateurs la même latitude qu’offrait Excel. Ensuite, le nettoyage du référentiel est fait en amont, les contrôleurs de gestion n’ont plus à stocker leurs bases de données dans Excel. Et le logiciel va même plus loin ! Avec Inside, il est possible de pouvoir entrer de l’information dans le système d’information. Le Contrôleur de Gestion saisit ses données et peut les injecter dans le système, comme pour le budget par exemple. C’est un atout indéniable. Aussi, Inside est un vrai outil d’analyse. Il représente une alternative aux outils lourds comme Business Object qui nécessitent plus de formation et d’appétence technique. Enfin, le progiciel est un outil collaboratif, il permet le partage de fichiers sans passer par la messagerie dont les envois répétitifs saturent la mémoire des boites mails

M. Labbé, diriez-vous qu’Inside fait partie de la catégorie des outils dits « LAB » ?

Il faut déjà préciser ce qu’est un « LAB ». De mon point de vue, un LAB est un simulateur qui permet d’éprouver des modèles. Si le client recherche un modèle ou un nouveau business modèle, il peut le tester avec un outil LAB pour trier et sélectionner les datas, les valider puis les industrialiser. En ce sens, Inside répond parfaitement aux caractéristiques d’un outil LAB.

D’une part, Inside est assez simple à utiliser et donne une grande latitude au Contrôleur de Gestion dans l’exploitation de la donnée. D’autre part, dans le cadre où il n’y a pas d’outil de reporting, le Contrôleur de Gestion va exprimer son besoin à son service informatique. A ce moment-là, Inside devient un moyen d’exprimer un besoin, il peut faire l’objet d’un laboratoire test. Par ailleurs, Inside peut faire office de système de secours lorsque la donnée n’est pas organisée dans un entrepôt ou dataware. Inside est utile dans la mesure où il permet de faire patienter tout le monde, il donne de la souplesse lorsque la réactivité de la Direction des Systèmes d’Informations est menacée, étant surchargée par son carnet de commandes. Inside fonctionne également très bien là où les systèmes d’informations décisionnelles sont matures. Par exemple, chez Leasecom, nous avions des sous-systèmes d’informations, c’est-à-dire des informations stockées dans Excel. Cette situation était parfaitement aberrante ! Le vrai problème est l’hétérogénéité des données car selon les systèmes d’information, la donnée change, elle n’a plus le même code, la même signification. Dans ce cas-là, Inside permet de faire le lien entre ces systèmes et d’interpréter la donnée au sens le plus juste. En réalité, Inside permet de se concentrer au cœur de l’information. Il met en opposition système décisionnel mature où les données sont habituelles et système décisionnel laboratoire où les données sont nouvelles et constamment testées et simulées.

Je vous remercie M. Labbé. Une dernière question, recommanderiez-vous Essentiel Info ?

Oui, bien entendu ! Je recommanderais Essentiel info pour son approche humble, efficace et attentive auprès de ses clients. Je leur ai d'ailleurs confié une nouvelle mission de conseil pour nous aider à trouver le remplaçant de Business Object.

En bref

Fondée et dirigée par Stéphane Robert depuis 10 ans, Essentiel Info simplifie le Data Management pour permettre à ses clients de disposer de la bonne information et de prendre les bonnes décisions. Essentiel Info propose des solutions décisionnelles Lean pour le pilotage d’activité et de trésorerie, le reporting réglementaire et la connaissance clients.

Pourquoi Excel est toujours au cœur des entreprises ?

Créé au début des années 80, Excel, le tableur de Microsoft Office est encore aujourd’hui un outil incontournable des entreprises. Il est en particulier plébiscité par les Directeurs Financiers et les contrôleurs de Gestion dans les PME/PMI, les ETI jusqu’au plus grands groupes français et internationaux.

Comment expliquer la résilience d’Excel ?

Excel permet la création de tableaux simples ou complexes, d’illustrations graphiques et de mises en formes conditionnelles à la plupart des utilisateurs qui vont consentir un apprentissage de quelques jours.

Ses fonctions simples connues du plus grand nombre en font l’outil naturel pour faire parler soi-même ses données. Excel est doté de fonctionnalités plus complexes tels les tableaux croisés dynamiques, ses macros ou sa capacité de connexion à des sources de données externes. Il se trouvera toujours quelqu'un dans le bureau d'à côté ayant creusé ainsi le sujet pour devenir un expert d’Excel auxquels les utilisateurs standards peuvent recourir en cas de besoin sans faire appel à l'informatique…

Excel, « l’application » parfaite pour manipuler des données ?

A l’ère du Big Data et de l'intelligence artificielle, Excel est encore, au dire de tous les professionnels, l’outil d’analyse de données le plus utilisé par de très nombreuses équipes métier. Fou n'est ce pas ? Un exemple dans le bureau du contrôleur de gestion. Celui-ci va extraire des données de son logiciel métier sous Excel. Il va ensuite trier pour n’utiliser que ce dont il a spécifiquement besoin. Evidemment le risque d’erreur est important et l’utilisateur n'hésite pas de procéder à de multiples vérifications pour fiabiliser ses données. Le résultat est simple : aujourd'hui encore dans beaucoup d'entreprises ayant pourtant investi de grande somme aux outils décisionnels du marché, des temps cumulés immenses accordés aux manipulations, retraitements des fichiers et autres contrôles fastidieux au détriment de l’analyse.

Certaines DSI ont fait le choix de développer leurs propres applications, d’autres de proposer des solutions sur la base de logiciels du marché pour permettre aux équipes métier de se concentrer sur leur vraie valeur ajoutée. Rien n'y fait. A l’heure de la transformation numérique, avec des équipes de la DSI surchargées et des équipes demandeuses d'une nouvelle analyse spécifique, le retour à la case Excel à l'air d'être inévitable !?

Et les éditeurs de logiciels décisionnels dans tout cela ?

De très nombreuses applications sont apparus pour répondre aux besoins des entreprises d’analyser les données ou de reporting automatisés. Chez les plus grandes aujourd'hui, chez SAP comme chez Oracle, au bout d'outils très sophistiqué, souvent un Add-in Excel.

L'aveu de notre point de vue, qu'une large autonomie dans un outil sûr et sécurisé, permet au métier de créer une vraie valeur ajoutée.

Le reporting collaboratif : encore un rêve pour beaucoup d’entreprises

Dans ces marchés en pleines mutations que connaissent vos entreprises, il ne suffit plus de savoir produire, de vendre, d’exceller dans les process. Vous créez de la valeur pour et avec vos clients ! Encourager l’innovation, favoriser la co-création, partager l’information. Le reporting collaboratif est un enjeu majeur pour nombre des entreprises.

Le partage de l’information avec Excel est-il encore possible ?

Quels que soit les outils sophistiqués mis en place par les DSI pour faciliter la collaboration, sur de nombreux sujets financiers, Excel n’a pas été délogé de sa place d’outil « à tout faire » le plus utilisé. La limite de ce couteau suisse du Directeur Financier c’est que l’information est statique pour les utilisateurs d’Excel. Chaque service travaille sur ses propres prérogatives, réalise ses reportings sous Excel et les sauvegarde sur le serveur de l’entreprise. Pour permettre une diffusion de cette information, les reportings sont envoyés par mail aux différentes équipes ou mis à disposition sur le serveur commun, sur Google Drive ou le Cloud de l’entreprise. Les équipes peuvent ainsi avoir accès aux documents et les consulter à volonté.

Souvent, ces tableaux de bord sont complexes car ils comportent beaucoup d’informations issues de diverses sources (outils de gestion, saisies des utilisateurs, budget, etc.), des formules imbriquées… La construction du tableau ne faisant pas toujours sens pour ses lecteurs, le reporting n’est donc maniable que par l’auteur. Parfois, lorsque le tableau est consulté par un autre lecteur, il lui est impossible de le mettre à jour ou de le recalculer, sans peine d’obtenir un message d’erreur ou pire de « détruire » l’architecture du reporting…

Les atouts du reporting collaboratif

Pour répondre à ce manque d’accès à l’information, les outils du reporting collaboratif se sont largement développés, mettant à disposition des entreprises des moyens efficaces pour permettre une diffusion de l’information en temps réel et des données à tout moment justifiables. L’objectif de ces outils est de créer une dynamique collective pour gagner en productivité et qualité de travail. L’accès à l’information est sécurisée par un identifiant et un mot de passe, les utilisateurs peuvent à tout moment consulter un fichier auquel sont attachés des droits de lecture et d’écriture et peuvent ainsi recalculer le classeur avec les données du jour et tout ceci sans obligatoirement disposer d’Excel. Ces bibliothèques interactives s’implantent dans une économie du partage et du savoir et forment ainsi un avantage concurrentiel simple pour les entreprises d’aujourd’hui.

Rédigé par Stéphanie Cambianica

En bref

Fondée et dirigée par Stéphane Robert depuis 10 ans, Essentiel Info simplifie le Data Management et propose des solutions décisionnelles Lean pour le pilotage d’activité et de trésorerie, le reporting réglementaire et la connaissance clients.

Quand l’urgence est le quotidien du contrôleur de gestion

Aujourd’hui, les actionnaires ou CODIRs de nombreuses grandes entreprises attendent les rapports sur l’état de l’activité dès le lendemain de la date d’arrêté de la période, du trimestre voire de l’exercice. Le temps réel est en passe de devenir le standard, l’urgence la règle.

Des reporting toujours plus en temps réel

Les données du mois dernier ne suffisent plus. Prendre les bonnes décisions et adapter la stratégie de l’entreprise dans un environnement en transformation est un exercice difficile. Les CODIRs exigent une connaissance fine et précise de l’activité pour les y aider.

Avec des moyens souvent inchangés, les équipes du contrôle de gestion doivent mettre les bouchées doubles et produire des reporting dans l’urgence avec un volume de données qui explose, au sein de Directions Financières résolument tournées vers une meilleure valorisation de la Data.

Un temps de contrôle important pour limiter le risque d’erreur avec Excel

Dans cette course contre la montre, les sources d’erreurs sont multiples. Les équipes se pressent. Elles collectent et traitent manuellement les données dans un tableur, le data-crunching leur prend beaucoup de temps, les copier/coller successifs ne sont pas sûrs et ne permettent pas de vérifier la provenance de l’information insérée dans le tableur. Les contrôles sont nécessaires mais chronophages car ils sont souvent faits manuellement, ligne par ligne parfois. Une erreur de saisie ou un oubli de vérification d’une cellule peut facilement passer à la trappe. La réconciliation des comptes est une étape délicate, et non automatisée, le risque d’erreur zéro n’existe pas.

Du fait de ces nombreuses opérations manuelles, le risque d’erreur est important et celui-ci augmente d’autant plus avec les délais urgents imposés. Les équipes du contrôle de gestion ont une épée de Damoclès au-dessus de leur tête. Au mieux leur réactivité est critiquée, au pire la qualité de leurs rapports est en danger.

Quelle nouveauté du côté des outils ?

De nombreuses solutions de Business Intelligence limitant le data-crunching par les équipes métiers tout en sauvegardant leur autonomie existent. En automatisant les reporting, certains outils de BI agile octroient à leurs utilisateurs beaucoup plus de temps à l’analyse. Et pour les meilleurs d’entre eux, sans complexité technologique.

En bref

Fondée et dirigée par Stéphane Robert depuis 10 ans, Essentiel Info simplifie le Data Management et propose des solutions décisionnelles Lean pour le pilotage d’activité et de trésorerie, le reporting réglementaire et la connaissance clients.

Un volume de DATA qui explose : Excel pourrait-il vous assurer un suivi de qualité des données à l’ère du Big Data

Selon une étude parue récemment dans Les Echos, la masse d’informations mondiale était de 100 millions Go en 2001, de 1,2 milliard en 2012 et sera de 35 milliards en 2020… soit en moins de 8 ans, un volume de données trente fois plus important ! Celles-ci sont issues des outils de gestion classiques des entreprises (Sage ou SAP par exemple), des données historiées ou externes, bien entendu des réseaux sociaux et des informations collectées sur les clients dans tous les nouveaux canaux digitaux et déjà bien sûr des premiers objets connectés.

L’exploitation de sources de données multiples : Excel est partout utilisé mais est-il toujours adapté ?

De nombreuses PME, mais aussi des ETI ou des divisions métiers de groupe stockent dans Excel les informations collectées puis les analysent, réalisant ainsi des reportings simples ou complexes mettant en relief l’information essentielle dont elles ont besoin. Grâce au tableur ou à d’autres outils plus évolués dans des entreprises plus richement dotées, La DATA est triée et mise à la forme souhaitée... Une question importante se pose partout, à laquelle les entreprises réfléchissent mais n’ont pas véritablement mis en place de réponses fiables : Comment s’assurer de l’exactitude des données provenant de tiers, d’outils ERP ou des réseaux sociaux ? Une fois les données regroupées sur un fichier Excel ou dans une base de données, le reporting créé et les résultats escomptés affichés, comment justifier un montant ou simplement une information erronée ? Les entreprises sont de plus en plus confrontées à ce problème : Excel permet à l’utilisateur métier de nettoyer les données mais n’est pas fait pour stocker un important volume d’information ; à l’inverse les outils dédiés à traiter le Big Data sont quant à eux exploités par des techniciens souvent bien loin du métier et du sens de la donnée. Le volume d’information grandissant en même temps que ses sources se multiplient, il devient crucial pour les entreprises de réussir à combiner le travail des hommes et des technologies d’aujourd’hui pour fiabiliser leurs données.

Des nouveaux outils présents sur le marché ?

La révolution fulgurante actuelle change les habitudes de la société et participe à l’explosion exponentielle du volume de données collectées. La masse d’informations créée encourage et favorise la création de nouveaux supports, de nouvelles méthodes et outils, voire de nouveaux métiers avec les recrutements qu’on commence à observer de Data Analyst, Data Scientists ou autres Chief Data Officer. Cette opportunité de création de valeur s’appuie sur une nouvelle génération d’outils dépassant les limites d’Excel et qui permettent à l’Homme de collecter, stocker, traiter, visualiser et utiliser les données d’une entreprise, quelle que soit sa source, avec un suivi de qualité permettant de s’assurer à tout moment de l’exactitude de l’information.

En bref

Fondée et dirigée par Stéphane Robert depuis 10 ans, Essentiel Info simplifie le Data Management et propose des solutions décisionnelles Lean pour le pilotage d’activité et de trésorerie, le reporting réglementaire et la connaissance clients.